Scrittura aumentata5 min read

Scrittura aumentata5 min read

Scrittura aumentata, tecnologie predittive, linguaggio artificiale e autorialità.

Questo articolo è estratto da Dylarama, la newsletter settimanale a cura di Siamomine su tecnologia, scienza, comunicazione, lavoro creativo e culturale.

Iscriviti qui per ricevere le prossime edizioni.

Pochi giorni fa, il magazine indipendente Real Life ha pubblicato un articolo sulla scrittura aumentata, ovvero sulle funzionalità di app e piattaforme che quotidianamente sfruttano tecnologie di word prediction per correggere errori, suggerire nuove espressioni e completare automaticamente le frasi che scriviamo. Nonostante l’idea di una scrittura AI-powered venga spesso promossa come il traguardo di una comunicazione online efficiente e impeccabile, le preoccupazioni dietro l’augmented writing non sono poche, e chiamano in causa problemi come la natura dei dati su cui vengono effettuati i training degli algoritmi o l’idea che l’adozione di un linguaggio neutrale, ripulito da imperfezioni e scelte stilistiche personali, sia una meta d’arrivo auspicabile. Nell’era del soluzionismo tecnologico, siamo sicuri che la scrittura sia l’ennesimo campo dell’agire umano che desideriamo immolare sull’altare dell’efficienza algoritmica?

È un tema sempre più discusso. Lo scorso anno, per esempio, ha fatto molto parlare l’iniziativa del Guardian di “far scrivere” un articolo a GPT-3, un generatore di linguaggio creato da un laboratorio di San Francisco, in grado di sfruttare l’apprendimento automatico per produrre testi human-like. Oltre all’articolo “scritto da un robot”, frutto di un importante lavoro di revisione e assemblaggio di diversi testi prodotti dal generatore in base agli input ricevuti, l’iniziativa comprendeva anche una guida all’editing dei testi generati da un’IA e un articolo (stavolta scritto da un umano) pubblicato con lo scopo di placare gli animi e contestualizzare la vera funzione di GPT-3. «GPT-3 is just the latest example of computer-assisted authorship, the process by which human authors use technology to enhance the writing process […] These machines do not have will, they do not have originality and they cannot claim authorship».

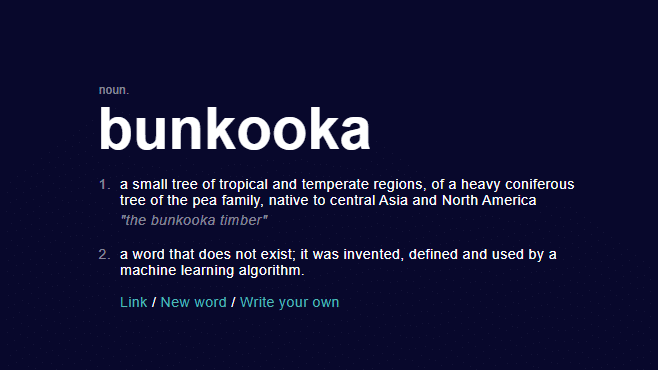

thisworddoesntexist.com è un generatore di vocaboli che non esistono, che sfrutta il natural language processing alla base del funzionamento di GPT-2 (il fratello un po’ meno in gamba di GPT-3) per inventare parole e definizioni introvabili sui vocabolari umani.

A proposito di GPT-2 e GPT-3, questo reportage pubblicato sul New Yorker ripercorre la storia delle più recenti tecnologie di predictive writing, dalla nascita dell’idea che la scrittura sia assimilabile alla computazione di stringhe di codice agli ultimi studi sul nlp. Come l’esperimento del Guardian, anche il testo del New Yorker include il contributo della macchina, che però stavolta interviene solo per ampliare il testo con paragrafi generati automaticamente sulla base delle informazioni fornite precedentemente. Nonostante l’esperienza da uncanny valley che attraversa sia il racconto che la lettura dell’approfondimento, il reportage mette in luce anche i limiti di una simile intelligenza artificiale, che si scontrano con la capacità di capire o contestualizzare ciò che viene predetto automaticamente.

Come spiega anche un approfondimento pubblicato sul New York Times, questo tipo di tecnologia ha raggiunto grandi risultati, incluso quello di emulare lo stile di Dr. Seuss per scrivere un poema su Elon Musk, ma una volta che ci si scontra con i limiti (sia computazionali che economici) di queste macchine, è difficile capire quale possa essere la direzione giusta da intraprendere nel progresso dell’artificial writing.

Come dimostrano video come questo, in cui due assistenti vocali sono posti l’uno di fronte all’altro per documentarne l’interazione con risultati che vanno dal curioso al nonsense più totale, le capacità di riproduzione del linguaggio umano da parte di queste intelligenze artificiali mostra tutti i suoi difetti in situazioni in cui la comprensione del contesto diventa centrale. È il motivo per cui le tecnologie di correzione automatica spesso falliscono anche di fronte agli scambi di testo più banali e perché nessun robot è ancora davvero in grado di scrivere un articolo senza un importante intervento umano.

Anche se nessuna macchina sta seriamente minacciando il ruolo dell’uomo nella produzione letteraria, ogni giorno intelligenze artificiali come GPT-2 e GPT-3 imparano ad automatizzare un pezzettino in più della scrittura umana, iniziando a produrre piccoli, ma significativi, cambiamenti sulla struttura del nostro lavoro e il modo in cui ci approcciamo al linguaggio. Per concludere, vi lasciamo con un articolo pubblicato questa settimana sul MIT Technology Review in cui viene spiegato perché, secondo le ultime ricerche, la strada per la comprensione del linguaggio umano da parte delle macchine è costellata di incertezze. Per citare uno dei ricercatori intervistati: «Nobody has a clue».